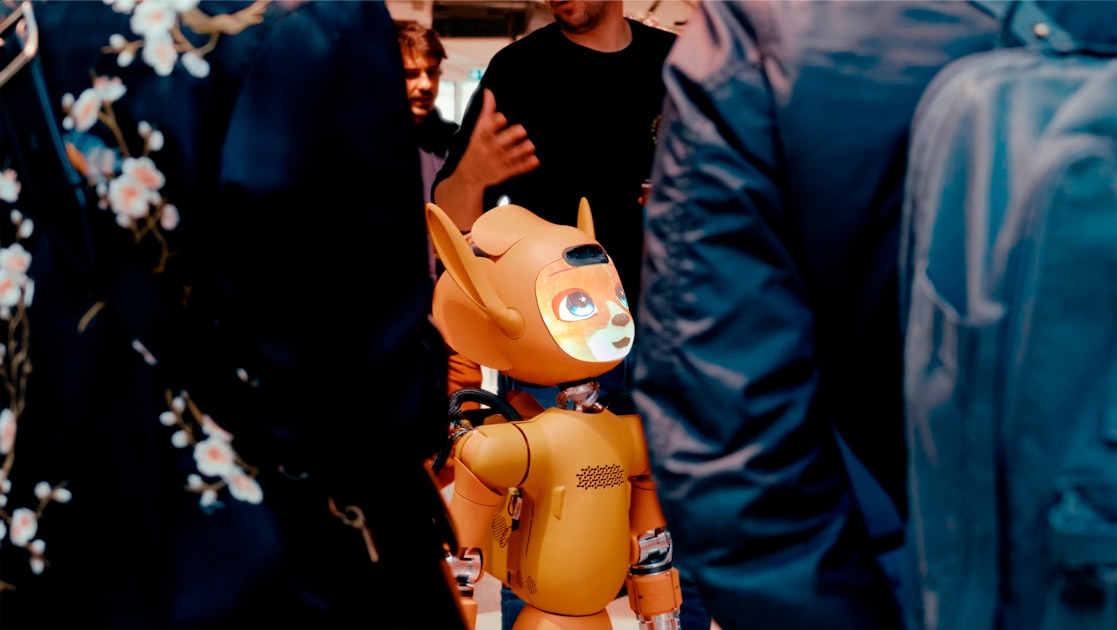

「AIコーディングアシスタントが物理的なロボットに乗り移ったら?」そんなSFのような実験を週末のハックで実現した開発者がいます。Claude Codeの出力をRealchy Miniロボットに接続し、ユニットテストを実行させてバグを発見・修正、さらにその結果を音声で報告させることに成功しました。「Embodied AI(身体化されたAI)」がコーディングタスクにおいてどのような体験をもたらすのか、この実験は非常に興味深い示唆を与えてくれます。

この記事のポイント

- Claude CodeとRealchy MiniロボットをMCP(Model Context Protocol)で接続

- 31のユニットテストを実行し、実際のバグを発見・修正

- 修正完了後、ロボットが口頭でスタンドアップレポートを報告

- レイテンシが改善され「非常に硬い同僚」のような体験に

Embodied AI:身体を持つAIコーディングアシスタント

この実験は、AIコーディングアシスタントの新しい可能性を探るものでした。通常、Claude Codeはターミナル上でテキストベースのやり取りを行いますが、今回の実験ではその出力をRealchy Miniという物理的なロボットにパイプしています。ロボットはカメラで開発者を認識し、首を動かしながらコミュニケーションを取ります。

実験では、ワークフローエグゼキューターの31のユニットテストを実行させました。その結果、Claude CodeはMassValidationError呼び出しにおける引数の誤りという実際のバグを発見。コードを修正し、テストをパスさせた後、ロボットは開発者の方を向いて「何をしたか」を口頭で報告しました。レイテンシが十分に低くなったことで、実際に「同僚と話している」ような感覚が得られたとのことです。

Realchy Mini MCPサーバーの仕組み

この実験を可能にしたのは、開発者が作成したMCPサーバーです。Model Context Protocol(MCP)は、AIモデルと外部ツールを接続するための標準プロトコルで、Claude Codeはこれを使ってさまざまなツールと連携できます。今回公開されたRealchy Mini MCPサーバーは、Claudeがロボットを自然言語で制御することを可能にします。

主な機能には以下のものがあります。ダンス機能では19種類の振り付けられた動きから選択するか、ランダムに実行できます。感情表現では事前に録画された感情表現を再生。頭の動きでは上下左右や正面への方向制御が可能です。カメラ機能でbase64エンコードされたJPEG画像をキャプチャし、顔追跡でユーザーの顔を自動追従します。そして音声合成はクラウドサービスを使わずにデバイス上でローカル実行され、8種類の声を選べます。

技術的なアーキテクチャ

MCPサーバーはPython 3.10以上で動作し、Realchy Mini SDK(バージョン1.2.7以上)を使用してロボットと通信します。ネットワーク接続にはZenohプロトコルを使用しており、ロボットのデーモンまたはシミュレーション環境が必要です。

特筆すべきは音声合成機能の実装です。「完全にデバイス上で実行される」ことが強調されており、APIへの依存、レイテンシの懸念、利用コストを排除しながら、テキストのプライバシーも保護しています。ロボットが話す際には頭のアニメーションも同時に実行され、より自然なコミュニケーションが実現されています。

実践してみよう

注意: このセクションでは元記事とGitHubリポジトリに記載されている手順のみを紹介します。Realchy Miniロボットの実機が必要です。

# リポジトリのクローン

git clone https://github.com/PixelML/reachy-mini-mcp.git

cd reachy-mini-mcp

# 仮想環境の作成(uvパッケージマネージャーを使用)

uv venv --python 3.10

source .venv/bin/activate

# 基本インストール

uv pip install -e .

# カメラサポート付きでインストール

uv pip install -e ".[camera]"

# 音声合成付きでインストール

uv pip install -e ".[speech]"

Claude Code CLIでMCPを登録するには以下を実行します。

claude mcp add reachy-mini-mcp --transport stdio -- /path/to/reachy-mini-mcp/.venv/bin/reachy-mini-mcp

環境変数は.envファイルで設定します。ロボット名(ネットワーク検出用、デフォルトは”reachy-mini”)、カメラの有効/無効、頭部追跡の初期化設定などが指定可能です。

知っておくと便利なTips

-

シミュレーション環境での検証: 実機がなくても、Realchy Mini SDKが提供するシミュレーション環境でMCPサーバーの動作をテストできます。コードの検証には十分な機能を持っています。

-

音声フィードバックの活用: 長時間のビルドやテスト実行中、ロボットの音声報告機能を使えば画面から目を離していても進捗を把握できます。特にCI/CDパイプラインの監視に応用できる可能性があります。

-

MCPの拡張性: このプロジェクトはMCPの可能性を示す良い例です。他のハードウェアデバイス(スマートホーム機器、IoTデバイス、産業用ロボットなど)にも同様のアプローチで接続できます。

-

レイテンシの重要性: 開発者が「同僚のような感覚」と表現しているように、AIとの対話においてレイテンシは体験の質に大きく影響します。Realchy Miniの応答速度が十分に速いことが、この実験の成功要因の一つです。

まとめ

この実験は、AIコーディングアシスタントの未来の一端を垣間見せてくれます。Claude Codeが単なるテキストインターフェースを超えて、物理世界と接続することで、開発者体験はどう変わるのでしょうか。ロボットが「見上げて」報告するという行為は、単純なテキスト出力よりも強い印象を残します。

もちろん現時点では実用的というより実験的なプロジェクトですが、MCPの柔軟性とClaude Codeの能力を組み合わせることで何が可能になるかを示す優れた事例です。MITライセンスで公開されているため、興味のある方はぜひコードを覗いてみてください。Embodied AIの世界は、思ったより近くにあるのかもしれません。

コメント