音声でターミナルを操作できたら――そんな開発者の夢を実現するプロジェクトが登場しました。OpenAI Whisperによる音声認識、大規模言語モデルによる意図分類、そしてファイル操作の自動実行を組み合わせた音声AIエージェントをPythonで構築する方法を、アーキテクチャから実装の詳細まで解説します。ローカル環境で完結するオフラインファースト設計が特徴で、開発者が自分だけの音声自動化パイプラインを構築するための実践的なガイドです。

この記事のポイント

- OpenAI Whisperを使った音声認識、LLMによる意図分類、ツール実行を一つのパイプラインに統合した音声AIエージェントの設計

- ローカルハードウェアで完結し、クラウドAPIはオプションのフォールバックとして利用するオフラインファースト設計

- ファイル作成・コード生成・テキスト要約・会話応答の4つのアクションを安全なサンドボックス内で実行

システムアーキテクチャ:4段階のリニアパイプライン

本システムは「音声入力 → 音声テキスト変換(STT) → 意図分類 → ツール実行 → UI描画」という4段階のリニアパイプライン構造を採用しています。各段階は独立したPythonモジュールとして実装されており、コンポーネントの差し替えが容易です。例えば、STTモジュールはローカルのWhisperとOpenAI Whisper APIを切り替えても、後続のコンポーネントに影響を与えません。

主要モジュールの構成は以下の通りです。stt.pyがWhisperによる音声書き起こしを担当し、intent_classifier.pyがLLMベースの意図検出を行います。tools.pyがツール実行、engineutils.pyが共有ヘルパーとフォーマット処理、そしてapp.pyがStreamlit UIとパイプライン全体の統合を担います。この明確な責務分離により、個別のモジュールテストや将来的な拡張が容易になっています。

音声認識:OpenAI Whisperの活用と実装上の工夫

OpenAI Whisperは68万時間の多言語音声データで訓練されたTransformerベースの自動音声認識モデルです。本プロジェクトでは精度と速度のバランスに優れた「base」モデルを採用しており、ディスク容量は約140MB、CPUでの処理時間は1発話あたり3〜8秒程度です。

実装上の重要なポイントとして、Windows環境での一時ファイルの扱いがあります。Pythonの標準的なNamedTemporaryFileはWindows上でファイルロックを保持するため、他のプロセスからの読み取りが阻害されます。この問題を解決するため、Whisperにパスを渡す前に明示的にファイルを閉じる処理が必要です。具体的には、tmp.close()をmodel.transcribe()の呼び出し前に実行し、delete=Falseオプションで一時ファイルが自動削除されないようにしています。こうしたクロスプラットフォーム対応の細かな配慮が、実用的なツール開発では欠かせません。

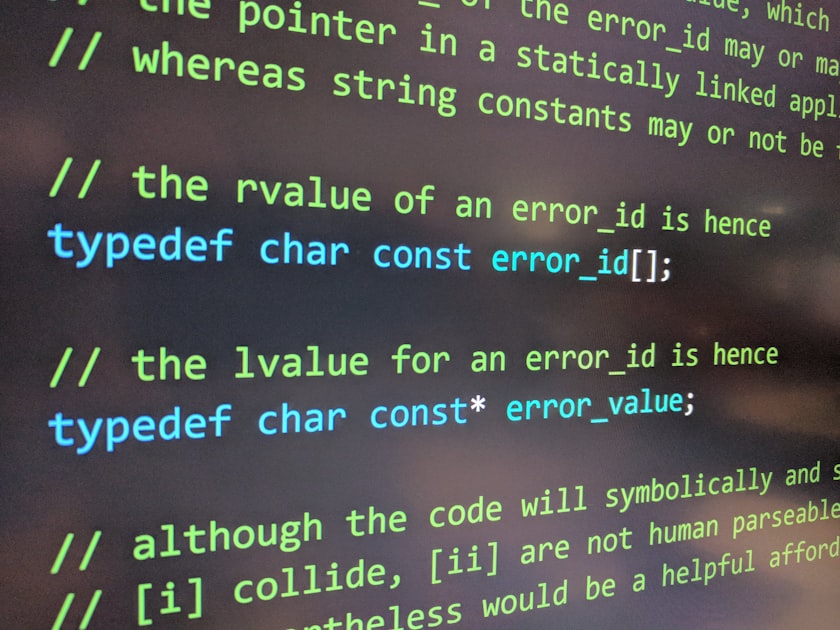

意図分類とツール実行:LLMの推論能力を活用

音声から変換されたテキストは、大規模言語モデル(LLM)による意図分類の段階に進みます。ここでは、ユーザーの発話内容から「ファイル作成」「コード生成・書き込み」「テキスト要約」「会話的な質問への応答」の4つのアクションのいずれかに分類します。LLMの自然言語理解能力を活用することで、厳密なコマンド構文に縛られず、自然な言い回しでの指示が可能になっています。

分類結果に基づいてtools.pyが対応するアクションを実行します。すべてのファイル操作は指定された出力ディレクトリにサンドボックス化されており、安全性を確保しながら実用的な機能を提供しています。コード生成機能ではLLMがPythonコードを生成してファイルに書き出し、要約機能では長文テキストの要点を抽出します。このように、音声という直感的なインターフェースを通じて、開発者の日常的なタスクを自動化できる設計となっています。

StreamlitによるリアクティブUI

本システムのフロントエンドにはStreamlitが採用されています。Streamlitはデータサイエンスやプロトタイピングで広く使われるPythonのWebフレームワークで、最小限のコードでリアクティブなUIを構築できます。app.pyがパイプライン全体を統合し、マイクからの音声入力やファイルアップロードの受付、処理結果の表示をすべてブラウザ上で行います。

Streamlitのリアクティブな特性により、音声入力から結果表示までのフローがシームレスに進行します。ユーザーは音声を録音するか音声ファイルをアップロードし、リアルタイムで書き起こし結果、分類された意図、実行結果を確認できます。開発者向けのツールでありながら、直感的なGUIで操作できるのが大きな利点です。

実践してみよう

元記事のアーキテクチャに基づく主要モジュールの構成は以下のようになっています:

project/

├── stt.py # Whisperによる音声書き起こし

├── intent_classifier.py # LLMベースの意図検出

├── tools.py # ツール実行(ファイル作成・コード生成等)

├── engineutils.py # 共有ヘルパー・フォーマット

└── app.py # Streamlit UI・パイプライン統合

Windows環境での一時ファイル処理の例:

tmp = tempfile.NamedTemporaryFile(delete=False, suffix=".wav")

tmp.write(audio_bytes)

tmp.flush()

tmp.close() # Windows環境では必須

result = model.transcribe(tmp.name)

知っておくと便利なTips

- Whisperの「base」モデルは約140MBと軽量で、GPUがなくてもCPUで3〜8秒程度で音声認識が可能。開発用途なら十分な性能を持つ

- 各モジュールを独立させるパイプライン設計により、例えばWhisperを別のSTTエンジンに差し替えたり、LLMプロバイダを変更する際も他のコンポーネントへの影響を最小限に抑えられる

- ファイル操作のサンドボックス化は安全性の面で重要。音声認識の誤変換による意図しないコマンド実行のリスクを軽減できる

- Streamlitを使えば、複雑なフロントエンド開発の知識がなくても、Pythonだけでリアクティブな音声入力UIを素早くプロトタイプできる

まとめ

本プロジェクトは、音声認識(Whisper)、意図分類(LLM)、ツール実行、そしてリアクティブUI(Streamlit)という4つの成熟した技術を組み合わせ、開発者向けの音声AIエージェントを実現しています。商用音声アシスタントが消費者向け市場を支配する中、開発者が独自の音声自動化パイプラインを構築するための実践的なアプローチを示している点が評価できます。ローカル環境で完結するオフラインファースト設計により、プライバシーやネットワーク制約のある環境でも利用可能です。音声インターフェースを自分の開発ワークフローに取り入れたい開発者にとって、良い出発点となるでしょう。

📎 元記事: https://dev.to/preethii_v_192006/talk-to-your-terminal-building-a-voice-ai-agent-in-python-51bm

コメント