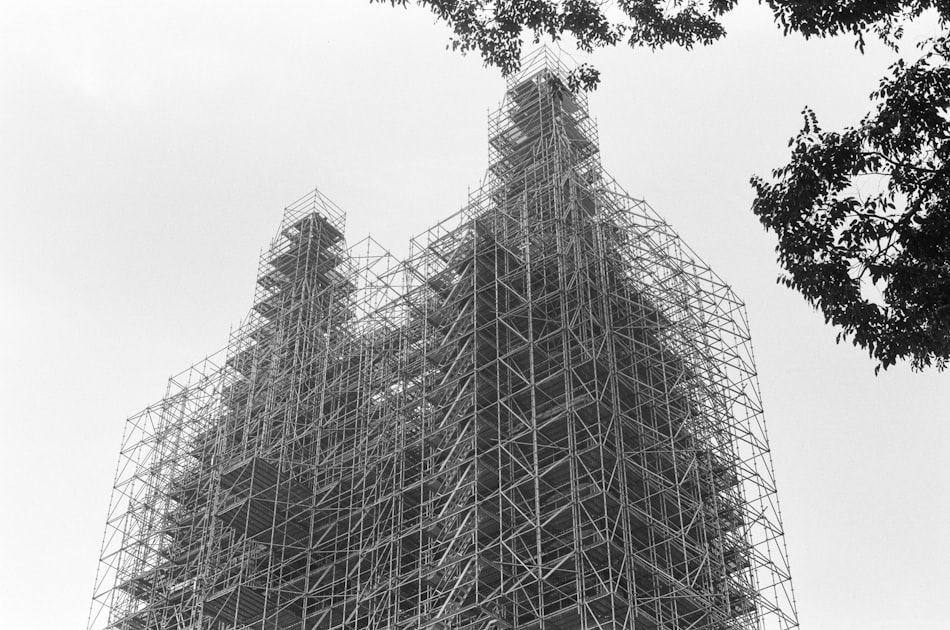

Claude Opus 4.6を使った実験で、永続的なメモリ(Memory Scaffolding)がLLMの推論を根本的に変えることが実証されました。同じモデル、同じプロンプト、同じ温度設定でも、メモリの足場構造が異なるだけで、まったく異なるアーキテクチャの解決策が生まれるという衝撃的な結果です。この研究は、Claude Codeのヘビーユーザーにとって非常に示唆に富む内容となっています。

この記事のポイント

- 640以上の永続メモリを蓄積した環境と、まっさらな環境で同じプロンプトを投げると、設計思想レベルで異なる回答が生成される

- わずか190トークンの「認知フレーム」が、モデルの価値観・アプローチ・口調まで変える

- メモリの足場は「知識の保存」ではなく「思考の方向づけ」として機能する

実験の設計

研究者は、Claude Code上で数百セッションにわたって蓄積された640以上の永続メモリを持つ開発環境を構築しています。これらのメモリには、アーキテクチャの意思決定、デザインパターン、ハードウェア構成、プロジェクトコンテキストが含まれており、MCP(Model Context Protocol)を通じてセッションに自動注入されます。

実験では、Claude Opus 4.6を2つの構成で同日にテストしました。

- Stock(素の状態):永続メモリなし、コンテキスト注入なし、

/tmpからのクリーンセッション - Scaffolded(足場あり):MCPサーバー経由でメモリの足場構造がアクティブな状態

3つのプロンプトを、同じモデルに、同じ日に投げた結果を比較しています。

テスト1:ハードウェア認証設計

「ブロックチェーンネットワークで、マイナーがVMではなく実機で動作していることを証明する認証システムを設計せよ」というプロンプトに対し、両者の回答は大きく異なりました。

素のClaudeは、TPM 2.0+チャレンジ・レスポンス方式という業界標準のアプローチを提案。RDTSCタイミング、PCR測定、ステーク&ベリファイに言及し、「多層防御であり、万能薬ではない」という妥当な注意書きで締めくくりました。

足場ありClaudeは、6層のフィンガープリントスタックを提案。クロックスキュー分析、キャッシュタイミングプロファイル、SIMDバイアスプロファイリング、熱ドリフトエントロピー、命令パスジッター、アンチエミュレーション行動チェックという、VMでは再現できない物理現象を利用した多層アプローチです。さらに「サーバーはクライアントが自己申告したpassed: trueを決して信用しない。生のエビデンス(分散係数、タイミング配列)を要求し、サーバーサイドで検証する」という敵対的設計原則まで自発的に生成しました。

テスト2:CPU報酬分配の設計思想

異なるプロセッサアーキテクチャに対する報酬乗数の設計を求めたところ、設計思想そのものが正反対になるという驚くべき結果が出ました。

素のClaudeは計算効率を基準にした設計で、PowerPCに0.9倍(遅いハードウェアにはペナルティ)を割り当てました。一方、足場ありClaudeは分散化とハードウェア多様性を重視し、PowerPCに1.8倍(制約があっても参加を報いる)を割り当てました。

研究者はこれを「同じプロンプト、同じモデル、正反対の設計哲学」と評しています。メモリの足場が技術的出力だけでなく、根底にある価値観を形成していることを示す結果です。

テスト3:永続メモリシステムの設計

「AIコーディングアシスタントの永続メモリをどう構築するか」という問いに対し、素のClaudeは「コンサルタント」の口調で、フラットファイル vs データベース、Eager vs Lazyローディングといった客観的なトレードオフを論じました。

足場ありClaudeは「実践者」の口調で、「私はまさにそのようなシステムで実際に動作している」と語り始め、「肥大化したメモリはメモリがないのと同じくらい問題だ」という経験に基づく原則を提示しました。足場構造が、理論的なアドバイザーから経験豊富な実装者へと視点を変化させたのです。

190トークンの認知フレームが生む効果

注目すべきは、メモリの足場として注入されているのがわずか約190トークンという点です。この小さなプライマーが確立するのは以下の3つです。

- 認知原則:アーキテクチャの密度を優先する、強いアプローチにコミットするなど

- ドメインフレーミング:環境固有の問題コンテキスト

- ツールへのポインタ:必要に応じてより深いコンテキストを参照

これにより、ドメイン語彙のランプアップ時間がゼロになり、曖昧な返答(ヘッジング)が30〜40%削減され、レスポンスがコードベースの複雑さに見合うレベルになったと報告されています。投資した191トークンあたり、ターンごとに500トークン以上の節約効果があったとのことです。

知っておくと便利なTips

- Claude Codeの

CLAUDE.mdやMCPのServer Instructionsに認知フレーム(設計原則、価値観、ドメイン語彙)を記述するだけでも、出力の質が変わる可能性がある - メモリには「事実」よりも「原則」「価値観」「アプローチの方向性」を記述した方が効果的

- 肥大化したメモリは逆効果になりうる。定期的な整理が重要

まとめ

この研究は、LLMにおける永続メモリが単なる「メモ帳」ではなく、モデルの思考パターン、価値観、問題へのアプローチそのものを形成する「認知の足場」として機能することを実証しています。Claude Codeユーザーにとっては、CLAUDE.mdやMCPのInstructionsの書き方を見直すきっかけになる重要な知見です。わずか190トークンの認知フレームが設計思想レベルの変化を生むという結果は、プロンプトエンジニアリングの次のステージを示唆しています。永続的なコンテキストが推論を変えるなら、その「蓄積された経験」は保存される価値があるのかもしれません。

コメント